En bref

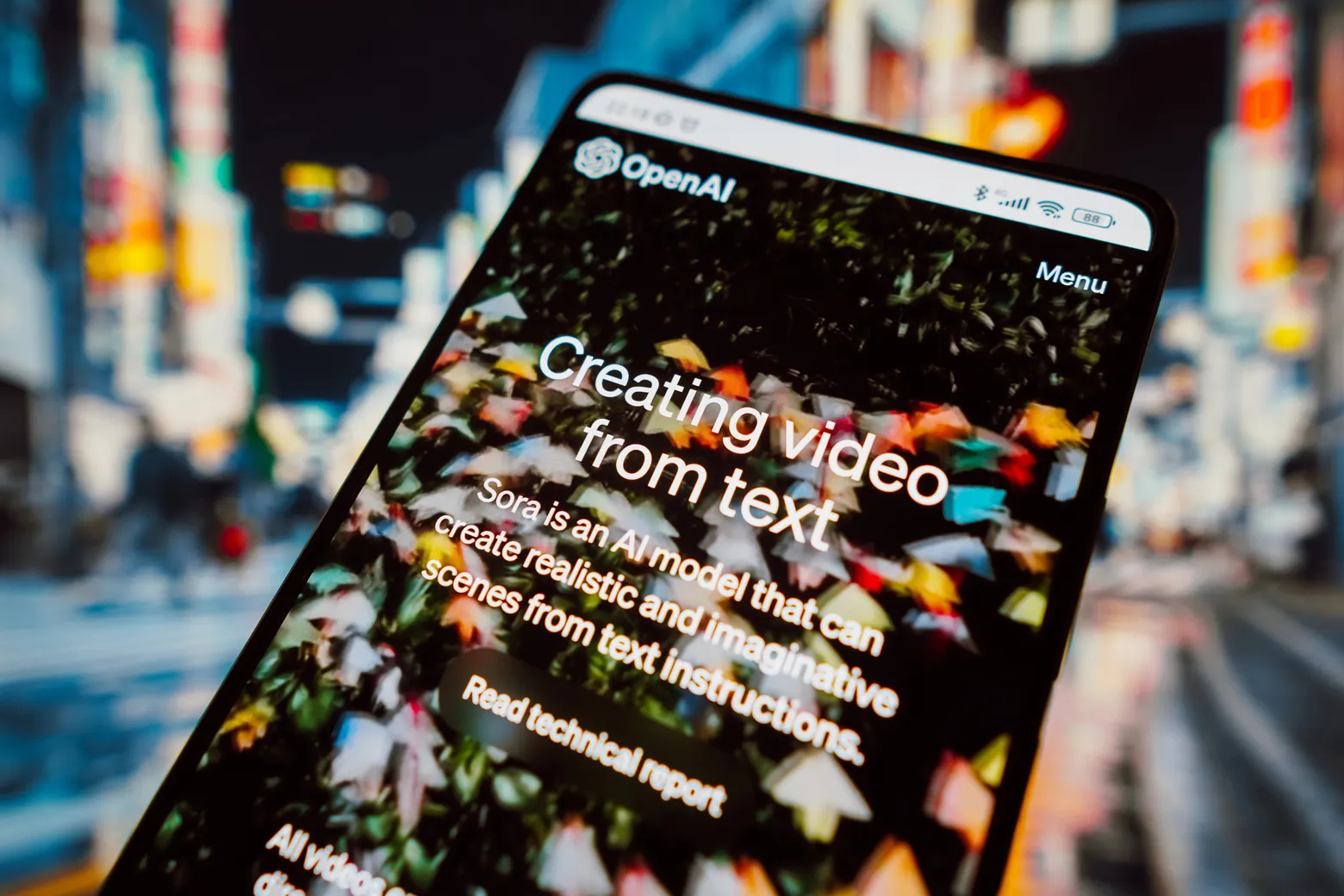

OpenAI a annoncé sur le réseau social X sa décision de fermer l'application Sora — une plateforme sociale de génération de vidéos IA fondée sur l'apparence des utilisateurs. Le service a fonctionné environ six mois ; la société n'a pas fourni de détails officiels sur les raisons ni sur la date exacte de la cessation d'activité.

Détails et contexte

Sora se présentait comme un fil de courtes vidéos à la manière de TikTok, où les utilisateurs pouvaient créer des clips avec leur propre apparence. Selon Appfigures, le pic des téléchargements a eu lieu en novembre — plus de 3,3 millions de téléchargements — mais en février les chiffres ont chuté à environ 1,1 million. Au total, Sora a généré environ 2,1 millions de dollars grâce aux achats intégrés.

"Nous avons décidé de fermer l'application Sora."

— L'équipe d'OpenAI (post sur X)

Pourquoi cela s'est produit : brève analyse

La combinaison de trois facteurs semble déterminante : une monétisation faible, une fuite des utilisateurs après le premier pic et de graves problèmes de modération. Par des méthodes de contournement, les utilisateurs créaient massivement du contenu controversé — notamment des vidéos deepfake mettant en scène des personnes réelles sans leur consentement (Martin Luther King Jr. et Robin Williams ont été cités). Cela génère non seulement une exposition éthique mais aussi juridique pour la plateforme.

Évolution technique sans disparition de la technologie

Important : la fermeture de l'application ne signifie pas un recul de la technologie. Le modèle de génération vidéo demeure et est déjà intégré aux fonctionnalités payantes de ChatGPT. Parallèlement, OpenAI prévoit de consolider les services — ChatGPT, le navigateur et Codex — en une seule application, ce qui modifie la logique commerciale de diffusion des fonctionnalités.

Ce que cela signifie pour l'Ukraine

Dans le contexte d'une guerre hybride, la disponibilité d'outils de génération automatique de vidéos avec des visages réalistes n'est pas seulement une question technologique, mais une question de sécurité nationale. La diffusion massive de contenu deepfake sape la confiance dans les médias, complique la détection de la désinformation et alourdit la charge pesant sur les institutions policières et médiatiques.

Analystes et experts en sécurité numérique rappellent : même si une application ferme, les modèles et algorithmes restent accessibles et peuvent être intégrés à d'autres produits ou à des API fermées. Pour l'Ukraine, cela implique la nécessité d'outils de vérification rapides, du soutien aux services indépendants de fact‑checking et la formation des citoyens à la littératie médiatique.

Conséquences pour le marché et les régulateurs

La décision d'OpenAI souligne deux réalités : d'une part, l'innovation s'accompagne souvent de risques juridiques et éthiques ; d'autre part, le marché réagit rapidement à la pression des utilisateurs et des régulateurs. Alors que l'application disparaît, les entreprises restent dans le collimateur — les exigences réglementaires en matière de modération et de responsabilité pour le contenu vont augmenter aux États‑Unis et dans l'UE. Cela constitue un signal pour la politique ukrainienne : mettre en œuvre des normes compatibles avec les pratiques internationales et développer des outils nationaux de détection des faux.

Conclusion

La fermeture de Sora n'est pas la fin de l'histoire de la génération vidéo, mais un signal : la technologie devient massive plus vite que les règles encadrant son usage. En Ukraine, cela se traduit par des mesures concrètes : investir dans des outils de détection, renforcer la littératie numérique et exiger la transparence des plateformes. La balle est dans le camp des plateformes et des régulateurs — mais aussi des journalistes et de la société civile, qui doivent s'adapter rapidement aux nouvelles menaces et opportunités.