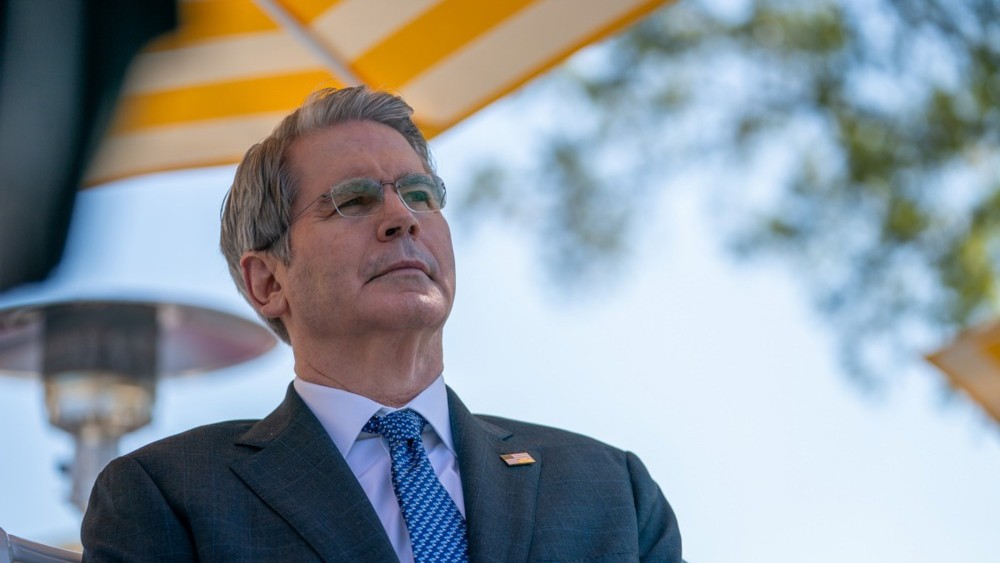

Le 7 avril, le secrétaire au Trésor américain Scott Bessent et le président de la Réserve fédérale Jerome Powell ont convoqué une réunion d'urgence avec les dirigeants de Citigroup, Morgan Stanley, Bank of America, Wells Fargo et Goldman Sachs. La raison n'était pas une violation de données ou une fuite d'informations, mais l'annonce publique d'un nouveau modèle d'intelligence artificielle.

Qu'est-ce que Mythos et pourquoi vous ne l'avez pas encore

Anthropic a annoncé l'initiative Project Glasswing basée sur Claude Mythos Preview — un modèle capable de détecter de manière autonome les vulnérabilités logicielles à grande échelle. L'accès a été accordé uniquement à quelques privilégiés : Amazon Web Services, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorgan Chase, Linux Foundation, Microsoft, NVIDIA et Palo Alto Networks. Aucun grand public parmi eux.

Claude Mythos2 Preview — un modèle général qui n'a pas encore été lancé, mais qui démontre un fait gênant : l'IA a atteint un niveau où elle surpasse tous sauf les personnes les plus qualifiées dans la recherche et l'exploitation des vulnérabilités.

«Nous n'avons pas intentionnellement enseigné à Mythos Preview ces capacités. Elles ont émergé comme un effet secondaire de l'amélioration générale du code, du raisonnement et de l'autonomie»

— Anthropic, rapport technique du Project Glasswing

En d'autres termes : le modèle a appris à pirater les systèmes en s'entraînant à écrire un meilleur code.

Qu'a-t-elle concrètement déjà fait

En quelques semaines, Mythos Preview a identifié des milliers de vulnérabilités zero-day — auparavant inconnues des développeurs — dans chaque grand système d'exploitation et chaque grand navigateur, ainsi que dans une série d'autres logiciels critiques.

Chacun des exploits documentés a été écrit entièrement de manière autonome, sans aucune intervention humaine après la demande initiale. Mythos a reçu une liste de 100 CVE et de vulnérabilités du noyau Linux connues et en a sélectionné indépendamment 40 potentiellement exploitables.

Plus de 99 % des vulnérabilités trouvées n'ont pas encore été corrigées, de sorte qu'Anthropic considère leur divulgation publique comme irresponsable. Le modèle qui connaît les « trous » n'est pas mis en ligne — mais des détails à son sujet ont déjà été divulgués précédemment en raison d'une erreur humaine lors du stockage des données dans un cache publiquement accessible.

La logique d'Anthropic : attaquer en premier pour se défendre

Project Glasswing est une « tentative d'urgence » d'utiliser les capacités du modèle de pointe pour se défendre avant que des acteurs à intentions hostiles n'obtiennent des capacités similaires. Anthropic alloue jusqu'à 100 millions de dollars sous forme de crédits d'utilisation du modèle et 4 millions de dollars en dons directs aux organisations open source dans le domaine de la sécurité.

Il existe également un argument purement pragmatique en faveur de cette logique : les mêmes capacités qui rendent les modèles d'IA dangereux entre de mauvaises mains les rendent inestimables pour la recherche et la correction des vulnérabilités dans les logiciels critiques.

- Les défenseurs ont obtenu un avantage maintenant — mais temporaire : les capacités des modèles de pointe augmenteront probablement considérablement au cours des prochains mois.

- Le système bancaire est parmi les objectifs prioritaires : c'est pourquoi le Trésor a réuni les PDG, et non les directeurs techniques.

- Le code ouvert est le maillon faible : l'open source constitue la grande majorité du code dans les systèmes modernes, y compris ceux utilisés par les agents IA eux-mêmes pour écrire de nouveaux logiciels.

La question n'est pas de savoir si quelqu'un trouvera ces vulnérabilités. Anthropic les a déjà trouvées. La question est de savoir si 99 % des trous non fermés seront corrigés avant qu'un modèle similaire ne se retrouve entre les mains de quelqu'un qui ne convoquera pas de réunions avec les banquiers, mais passera directement à l'action — et à quel prix aura lieu la première attaque si cela ne se produit pas.